記一次關(guān)于人工智能應(yīng)用方向的面試以及帶來的思考 原創(chuàng)

“ 大模型的應(yīng)用方向有多種,每種都有不同的技術(shù) ”

昨天在招聘網(wǎng)站上預(yù)約了一個(gè)人工智能應(yīng)用開發(fā)的面試,在面試的過程中對(duì)大模型應(yīng)用產(chǎn)生了一些討論,以及帶來了一些思考,在此做個(gè)記錄。

關(guān)于大模型應(yīng)用及問題的討論

以下所有內(nèi)容,在不特殊說明的情況下,問——指的是面試官,答——指的是我自己。

問:關(guān)于大模型訓(xùn)練與微調(diào),即怎么訓(xùn)練或微調(diào)一個(gè)大模型?

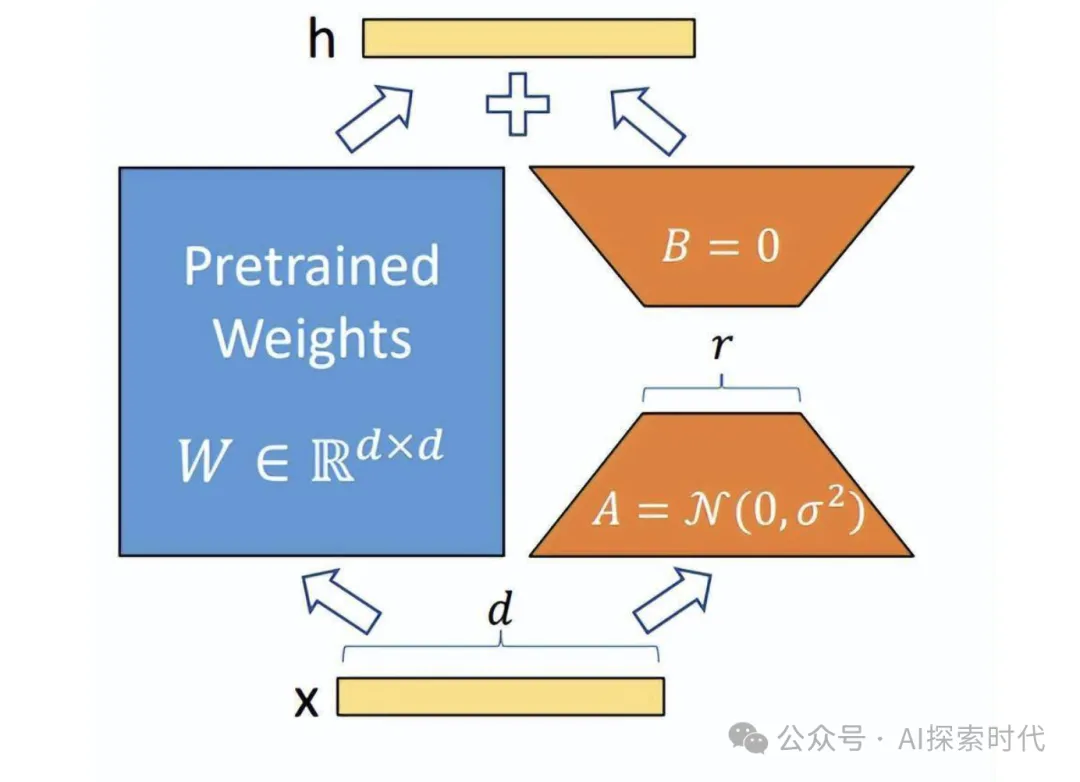

答:從技術(shù)的角度來說,模型的訓(xùn)練和微調(diào)沒有本質(zhì)的區(qū)別,目的都是對(duì)模型參數(shù)進(jìn)行調(diào)整;只不過模型訓(xùn)練是從一個(gè)隨機(jī)初始化的模型開始,而微調(diào)是基于一個(gè)經(jīng)過預(yù)訓(xùn)練的模型,對(duì)部分或全部參數(shù)進(jìn)行凍結(jié),只調(diào)整部分參數(shù)的過程。微調(diào)方法也有多種,如全量微調(diào)和高效微調(diào),如lora等。

訓(xùn)練和微調(diào)的過程也基本相似,都需要進(jìn)行數(shù)據(jù)收集,清洗;然后通過正向傳播,損失計(jì)算和反向傳播的方式對(duì)模型參數(shù)進(jìn)行調(diào)整;只不過微調(diào)有一個(gè)參數(shù)凍結(jié)的過程。

不論是訓(xùn)練還是微調(diào),目的都是為了讓大模型表現(xiàn)的更好。

問:百度的文心一言和阿里的通義千問有什么區(qū)別?

答:這個(gè)問題還真不清楚,只是在網(wǎng)上看到說文心一言和通義千問在不同的任務(wù)表現(xiàn)上有所不同。

問:你說你熟悉RAG,那你知道RAG是解決什么問題的嗎?其過程是什么樣的?會(huì)有哪些問題?

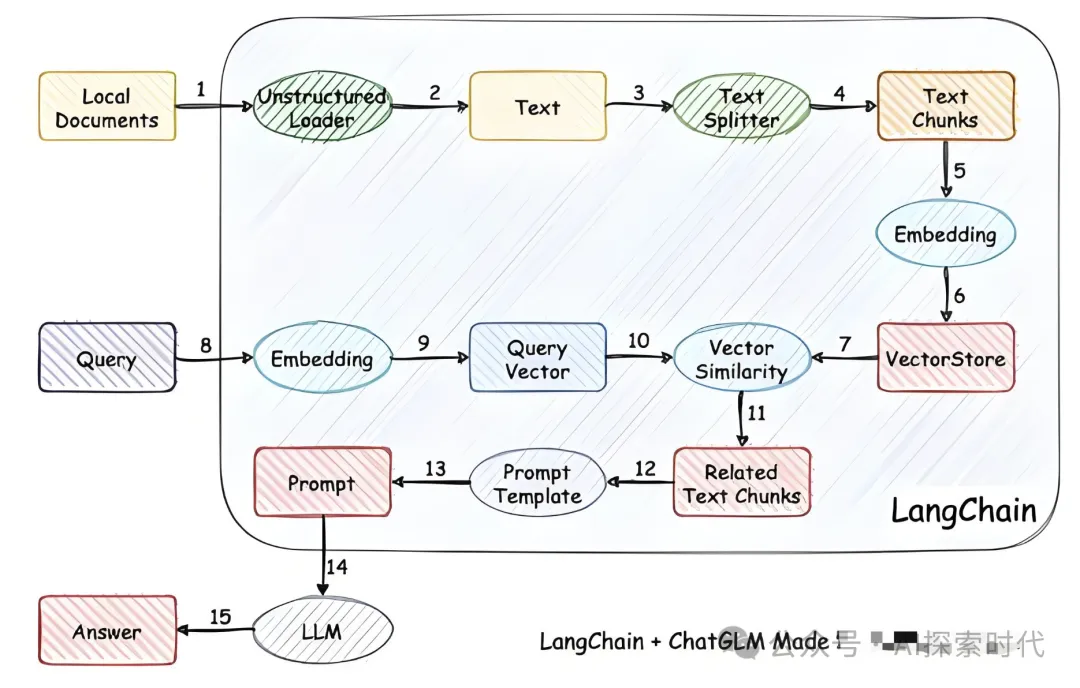

答:回答基本上和昨天發(fā)布的大模型知識(shí)庫(kù)搭建相同,RAG——檢索增強(qiáng)生成,是通過外掛知識(shí)庫(kù)的方式,每次用戶提問時(shí)先從向量數(shù)據(jù)庫(kù)中根據(jù)語義查詢相似文檔,然后通過提示詞的方式一起提交給大模型,主要用來解決三個(gè)問題,大模型的知識(shí)限制,一是時(shí)間限制,二是垂直領(lǐng)域限制,以及大模型的幻覺問題。

然后,打造知識(shí)庫(kù)需要經(jīng)過文檔加載(包括多種類型的文檔),文檔拆分,向量化,存儲(chǔ)等。

問:你說RAG能解決大模型的幻覺問題,那么大模型產(chǎn)生幻覺的根本原因是什么?

答:大模型產(chǎn)生幻覺的主要原因是因?yàn)橹R(shí)不足,或者說大模型以上三個(gè)問題都是因?yàn)橹R(shí)不足的問題。

問:如果大模型的幻覺問題是因?yàn)橹R(shí)不足,那么為什么提供很高質(zhì)量的知識(shí)庫(kù)依然無法完全避免幻覺問題?

答:知識(shí)庫(kù)只能在某種程度上解決幻覺問題,并不能完全解決幻覺問題,幻覺問題并不全是由知識(shí)不足引起的。

問:你知道大模型的實(shí)現(xiàn)原理嗎?什么是多層神經(jīng)網(wǎng)絡(luò)?

答:多層神經(jīng)網(wǎng)絡(luò)是指除了輸入層和輸出層之外,中間還有n層網(wǎng)絡(luò)的模型,不同層之間使用全連接或半連接的方向進(jìn)行通訊。(事實(shí)上神經(jīng)網(wǎng)絡(luò)有四種連接方式,全連接神經(jīng)網(wǎng)絡(luò),前饋神經(jīng)網(wǎng)絡(luò),卷積網(wǎng)絡(luò)和循環(huán)網(wǎng)絡(luò))

問:你是因?yàn)槭裁丛驅(qū)W習(xí)人工智能的?為什么平常不花時(shí)間學(xué)習(xí)大模型的技術(shù)原理? 大模型的推理過程是基于預(yù)測(cè)實(shí)現(xiàn)的,而預(yù)測(cè)是根據(jù)概率去生成內(nèi)容。因此,大模型產(chǎn)生幻覺的根本原因是其實(shí)現(xiàn)機(jī)制,建立于概率統(tǒng)計(jì)之上的預(yù)測(cè)模型。所以,大模型的幻覺問題是概率問題。

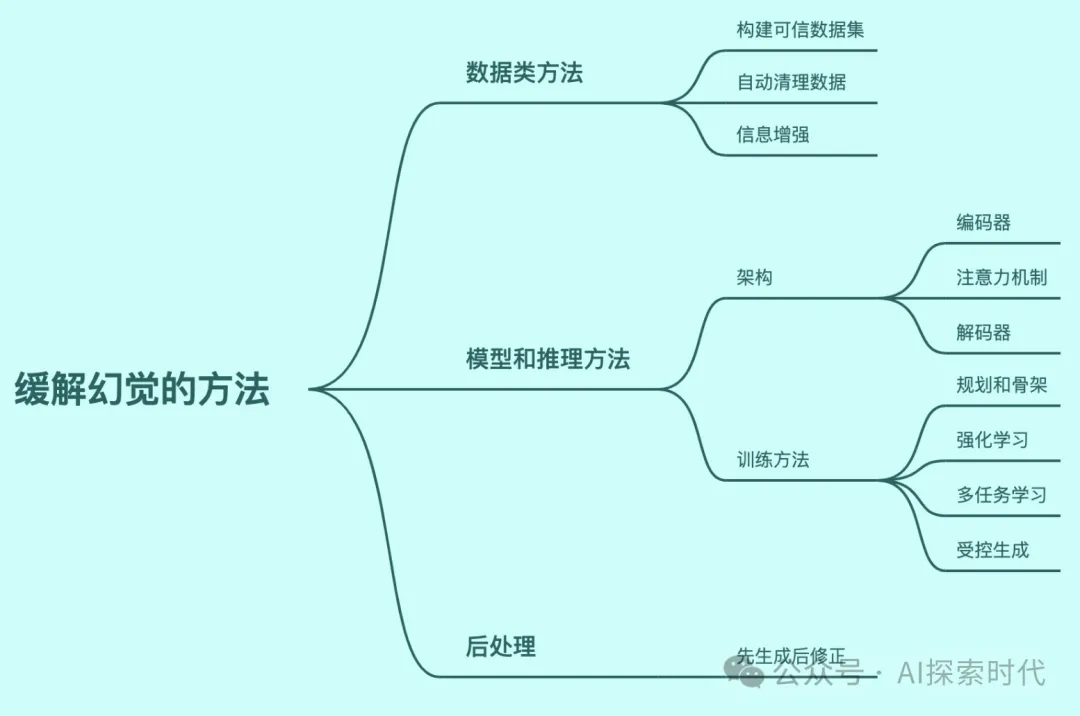

答:(內(nèi)心一驚,對(duì)呀大模型是基于概率統(tǒng)計(jì)的,怎么把這個(gè)給忘了) 概率問題只是大模型產(chǎn)生幻覺的原因之一,而知識(shí)庫(kù)能大大減少大模型產(chǎn)生幻覺。(事實(shí)上,大模型產(chǎn)生幻覺的原因有多種比如訓(xùn)練和微調(diào)數(shù)據(jù)的質(zhì)量,欠擬合,過擬合,大模型的結(jié)構(gòu)設(shè)計(jì)問題,知識(shí)不足問題等都可能引發(fā)大模型幻覺)

引發(fā)的問題和思考:如果說大模型幻覺產(chǎn)生的本質(zhì)原因是其自身的天生缺陷(概率),那么大模型的幻覺問題是否就無法完全解決?畢竟概率從來沒有百分之百。是否只能通過其它手段,無限逼近零幻覺?

因此,要想解決大模型的幻覺問題,是否需要從根本上推翻基于概率統(tǒng)計(jì)的大模型?使用其它新的方式來構(gòu)建大模型?

目前業(yè)界對(duì)大模型幻覺問題的主要態(tài)度好像是盡量減少大模型發(fā)生幻覺的可能性,雖然openAI的CEO奧特曼說要解決幻覺問題,但具體結(jié)果目前還不曉得。

問:你說你java和python都做是吧?那你是擅長(zhǎng)java,還是python? 我們這里缺的主要是java

答:現(xiàn)在搞人工智能不都是用python嗎?怎么還用java?

問:誰跟你說的搞人工智能都是用python,很多搞大模型的用的都是java還有g(shù)o

答:現(xiàn)在人工智能的主流開發(fā)語言就是python啊,并不是說其它語言不能搞,但主要都是用python搞。

問:你還有什么問題嗎?

答:你們這個(gè)項(xiàng)目是做什么的?需要用agent嗎?

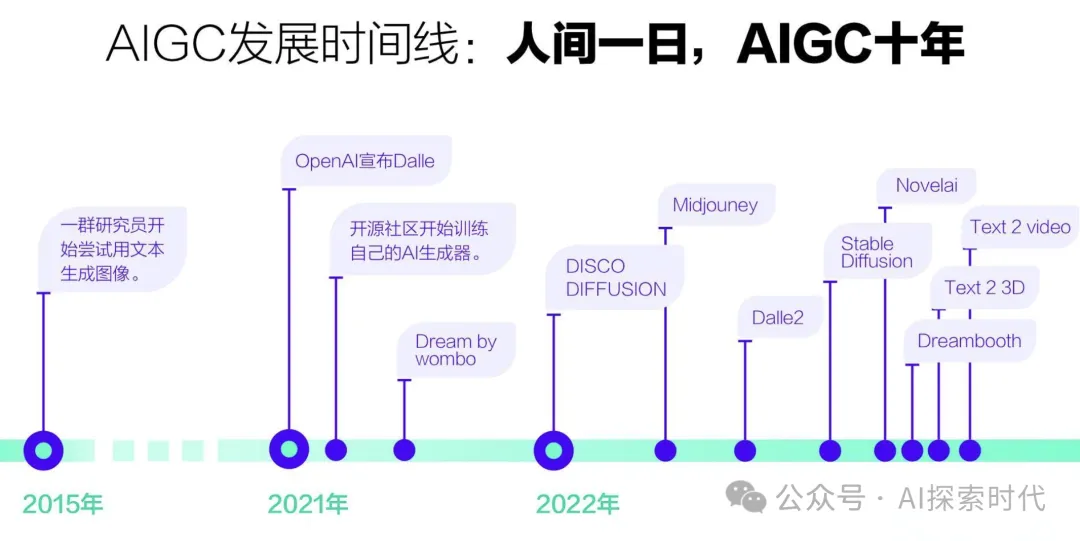

問:我們這個(gè)項(xiàng)目主要是調(diào)用第三方模型來生成一些內(nèi)容,比如輸入一些文字,根據(jù)文字給你生成圖片或視頻,甚至是同時(shí)生成圖片和視頻等。agent也會(huì)用,但不是很多。

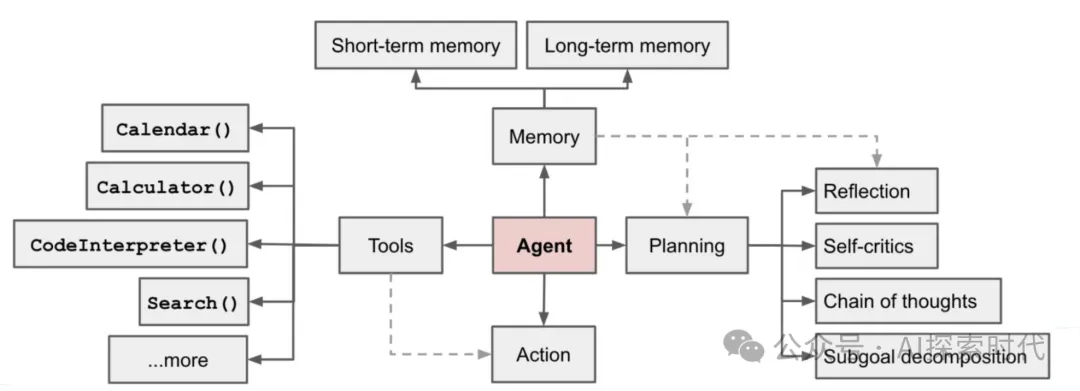

答:(內(nèi)心os 原來是做AIGC內(nèi)容生成方向的),agent不是現(xiàn)在的主流應(yīng)用方向嗎?

問:誰跟你說的,agent是主流方向?我們搞的是調(diào)用第三方模型生成內(nèi)容,文字,圖片和視頻;知道Copilot嗎?

答:網(wǎng)上都是這么說的啊,agent是實(shí)現(xiàn)通用人工智能的方向。Copilot是微軟推出的一款人工智能助手。

問:你是因?yàn)樵谘芯縜gent才會(huì)覺得agent是主流方向,python也是,你是因?yàn)橹饕獙W(xué)習(xí)python所以才覺得搞人工智能都是用的python。

這里兩個(gè)人已經(jīng)聊的有點(diǎn)叉劈了,當(dāng)時(shí)自己還沒反應(yīng)過來,總覺得兩個(gè)人的觀念有沖突。

其實(shí),AIGC和Agent是兩個(gè)不同的角度,AIGC是純粹的基于人工智能技術(shù)構(gòu)建的應(yīng)用,其主要偏向應(yīng)用,使用的是大模型天生的生成能力;而Agent雖然也是一個(gè)應(yīng)用方向,但其更偏向于一個(gè)技術(shù),其功能就是擴(kuò)展大模型的能力,讓它能夠調(diào)用外部工具。兩者的維度不同,兩者并不沖突,甚至是相輔相成。

答:你們的產(chǎn)品是2B還是2C的,是面向pc端,還是移動(dòng)端?業(yè)務(wù)方向是什么?比如2B領(lǐng)域的網(wǎng)絡(luò)營(yíng)銷推廣(用他們的平臺(tái)生成推廣文案,視頻等),還是針對(duì)個(gè)人的文案生成,視頻處理等?

問:我們先做2C,后續(xù)會(huì)平臺(tái)化,拓展2B的業(yè)務(wù);支持多端平臺(tái),如app,小程序,h5等;2C主要面向個(gè)人創(chuàng)作者,泛C端用戶,后續(xù)會(huì)根據(jù)運(yùn)營(yíng)情況,挖掘垂直場(chǎng)景。

答:針對(duì)某些領(lǐng)域內(nèi)容生成質(zhì)量問題怎么解決?

問:這個(gè)問題太空了,那個(gè)領(lǐng)域會(huì)有什么問題,再談解決

答:比如我是做漢服的,然后想使用你們平臺(tái)做一個(gè)宣傳推廣的視頻,根據(jù)文字描述,比如生成一個(gè)古裝俠客,在竹林中打斗的片段,重點(diǎn)突出穿的衣服。

問:文生視頻只是其中一種,diffusion可以使用lora控制風(fēng)格化輸出

答:對(duì)的,我就是說這種場(chǎng)景,不論是生成視頻,圖片,文字;三方模型并沒有在這些領(lǐng)域做過優(yōu)化,就會(huì)導(dǎo)致生成的內(nèi)容不僅人意,產(chǎn)生問題。而且微調(diào)成本也挺高的。

問:微調(diào)成本其實(shí)不高,主語看場(chǎng)景復(fù)雜度,以及用戶預(yù)期

答:但是每一種場(chǎng)景都需要進(jìn)行微調(diào)才行,這樣場(chǎng)景多了成本就高了。

因?yàn)樵诖酥耙恢睕]怎么關(guān)注AIGC ,問這個(gè)問題的主要目的是為了弄明白,在AIGC領(lǐng)域多種復(fù)雜場(chǎng)景問題是怎么解決的。怎么控制成本問題。

內(nèi)心OS: 原來AIGC還可以這樣玩,之前太膚淺了。

經(jīng)過這次面試,對(duì)大模型又有了更加深刻的認(rèn)識(shí),對(duì)知識(shí)庫(kù),大模型幻覺,AIGC,以及大模型的產(chǎn)品化都有了更進(jìn)一步的認(rèn)識(shí)和體會(huì)。

本文轉(zhuǎn)載自公眾號(hào)AI探索時(shí)代 作者:DFires

原文鏈接:????https://mp.weixin.qq.com/s/nDz849j261JSiGsEffTsiQ???