在線教程丨僅需極少量醫學影像數據,MediCLIP 在異常檢測與定位任務中刷新 SOTA 原創

在臨床診療過程中,醫學影像技術(如 X 光、 CT 、 B 超等)是醫生診斷的重要依據。當患者完成影像檢查后,通常需要由放射科或超聲科醫生對影像進行專業判讀,通過識別異常征象、定位病變區域并撰寫診斷報告,為臨床決策提供關鍵支持。

隨著人工智能技術的發展,醫學影像分析正迎來新的變革。目前基于機器學習已經能夠勝任醫學影像異常檢測的任務,即區分正常影像與病變異常影像,并識別這些病變區域的位置。這類技術在輔助醫學決策中發揮著關鍵作用,部分先進的檢測模型在特定任務上的表現甚至可與專業的臨床醫生相媲美,降低決策風險的同時提高了醫療人員的工作效率。

然而,現有的醫學影像異常檢測方法普遍依賴大規模數據集進行訓練,雖然可以取得較高性能,但也顯著增加了開發成本。

通用領域的 CLIP 模型在零樣本遷移上表現出色,但直接應用于醫學影像異常檢測時,受到領域差異和標注稀缺的限制。美國伊利諾伊大學香檳分校的研究團隊在 2022 年提出了 MedCLIP 方法,受到 CLIP 等視覺-文本對比學習模型的啟發,通過解耦圖文對比學習并引入醫學知識消除「假負例」,將這一范式擴展到醫學圖像分類與跨模態檢索,在數據量大幅減少的情況下依然取得了優異表現。

雖然 MedCLIP 在緩解數據依賴方面成效顯著,但其設計目標是分類與檢索任務,在異常檢測尤其是病灶定位方面并不適配。與此同時,近期有研究將 CLIP 應用于零樣本/小樣本異常檢測,其性能取得了令人印象深刻的效果。但這些方法往往需要真實異常影像及像素級標注的輔助數據集來進行模型訓練,這在醫療領域獲取困難。

針對這些問題,北京大學的研究團隊提出了一種高效的少樣本醫學影像異常檢測方案 MediCLIP 。該方法僅需極少量正常醫學影像,即可在異常檢測與定位任務中取得領先性能,并在多種醫學影像類型中有效檢測不同疾病,展現出驚人的零樣本泛化能力。

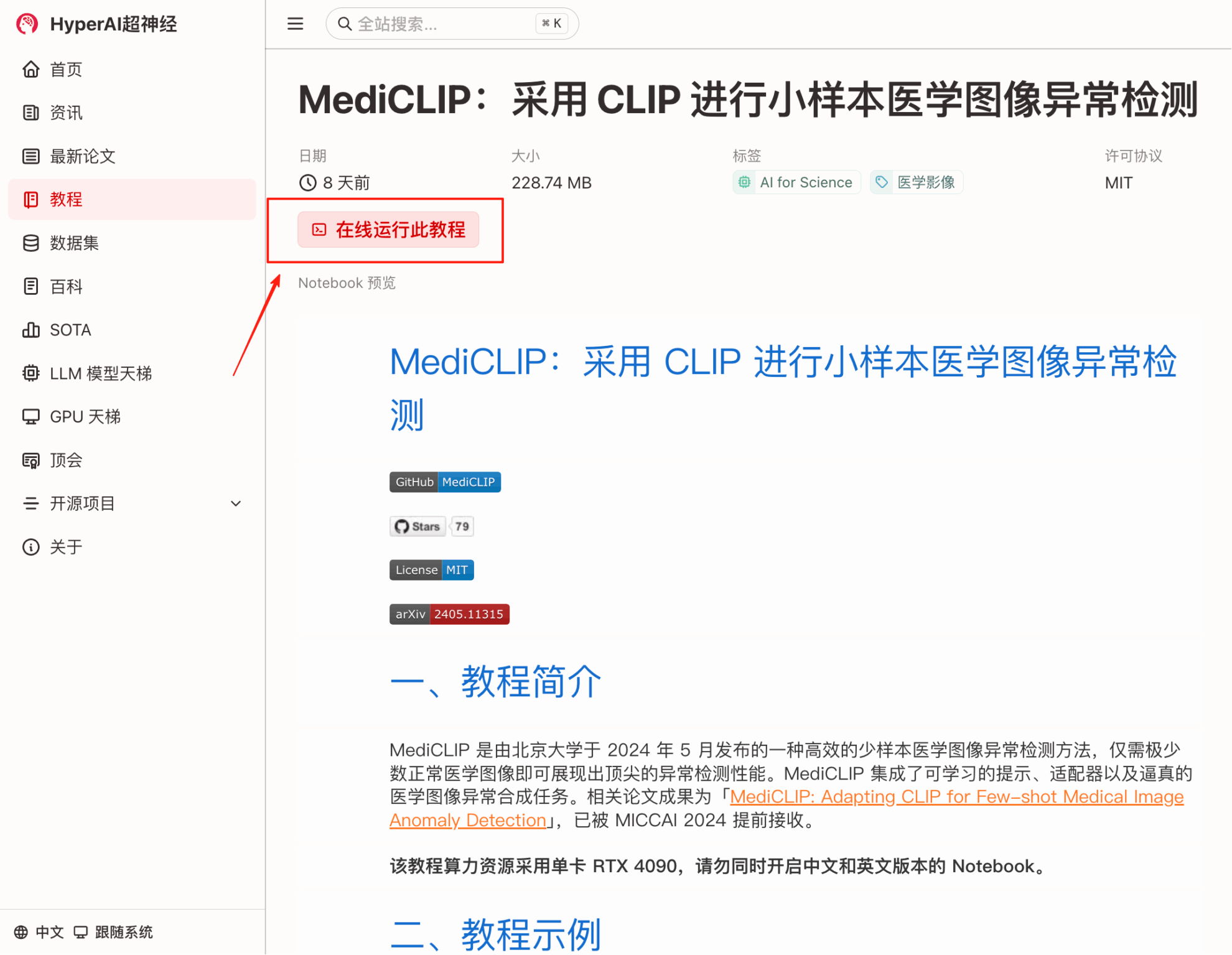

「MediCLIP:采用 CLIP 進行小樣本醫學圖像異常檢測」現已上線 HyperAI 超神經官網(hyper.ai)的「教程」板塊,快來體驗高效的醫學影像智能診斷方法吧!

教程鏈接:

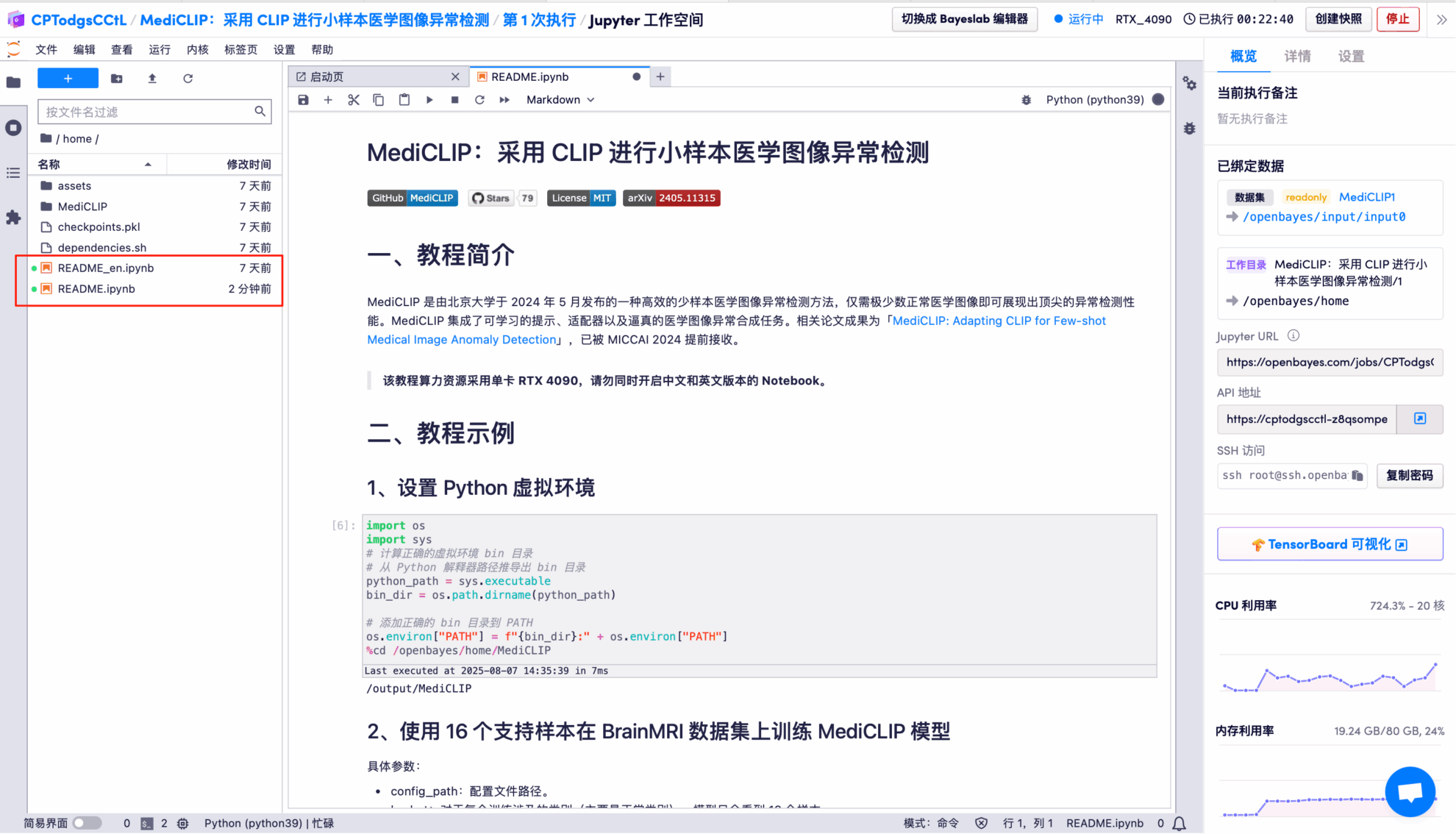

Demo 運行

1. 進入 hyper.ai 首頁后,選擇「教程」頁面,并選擇「MediCLIP:采用 CLIP 進行小樣本醫學圖像異常檢測」,點擊「在線運行此教程」。

2. 頁面跳轉后,點擊右上角「克隆」,將該教程克隆至自己的容器中。

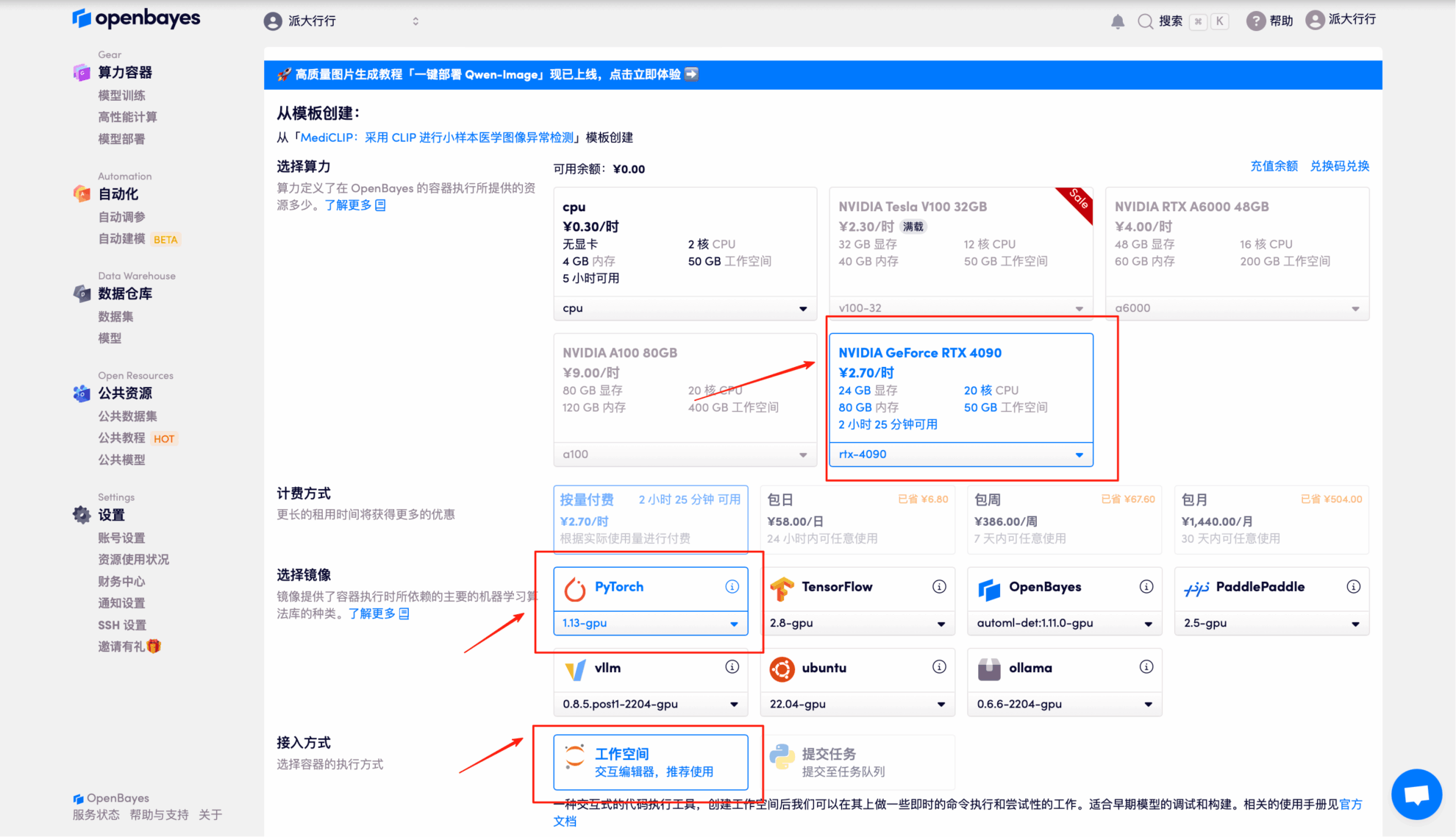

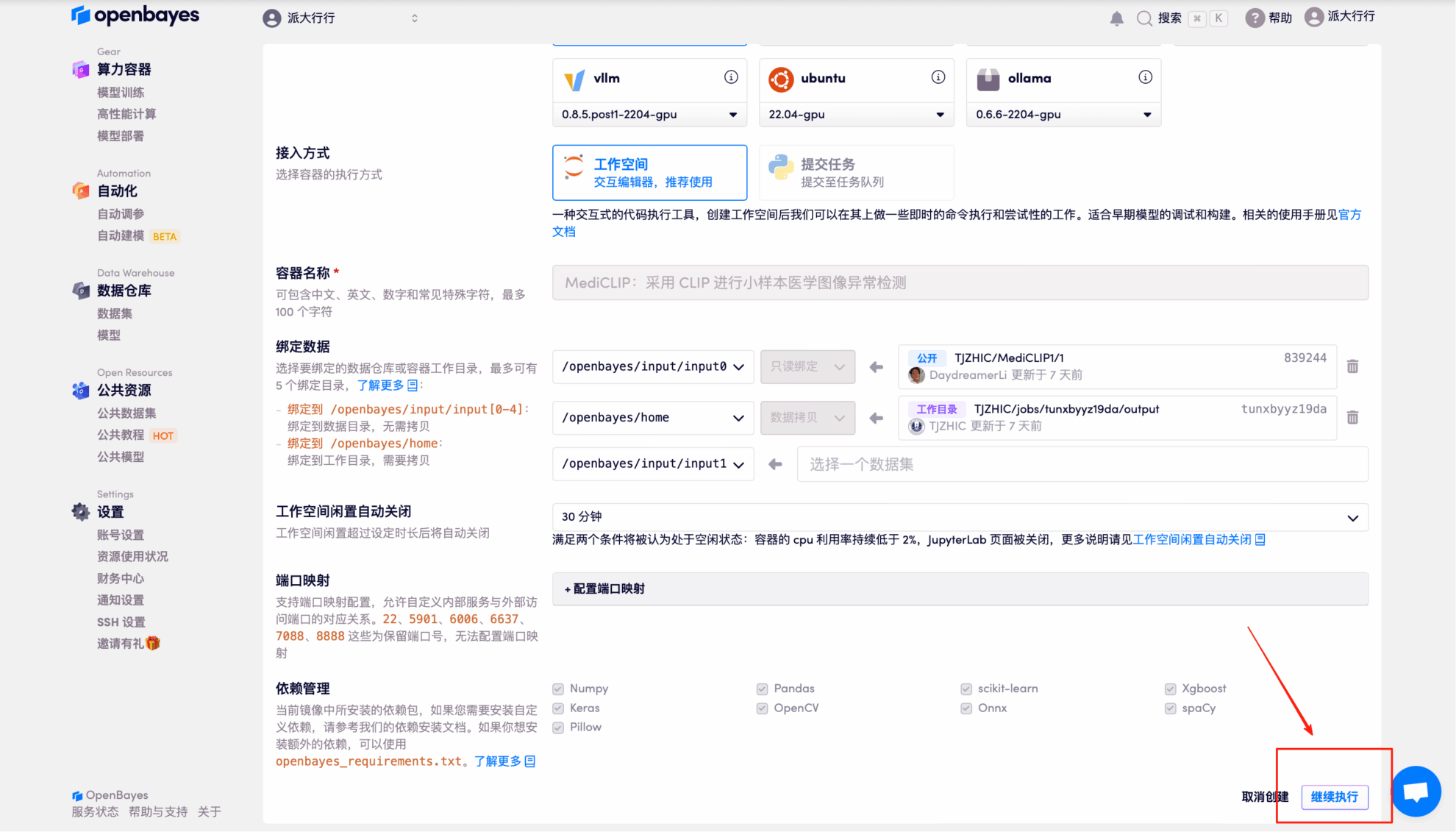

3. 選擇「NVIDIA GeForce RTX 4090」以及「PyTorch」鏡像,并點擊「繼續執行」。 OpenBayes 平臺提供了 4 種計費方式,大家可以按照需求選擇「按量付費」或「包日/周/月」。新用戶使用下方邀請鏈接注冊,可獲得 4 小時 RTX 4090 + 5 小時 CPU 的免費時長!

HyperAI 超神經專屬邀請鏈接(直接復制到瀏覽器打開):

??https://openbayes.com/console/signup?r=Ada0322_NR0n??

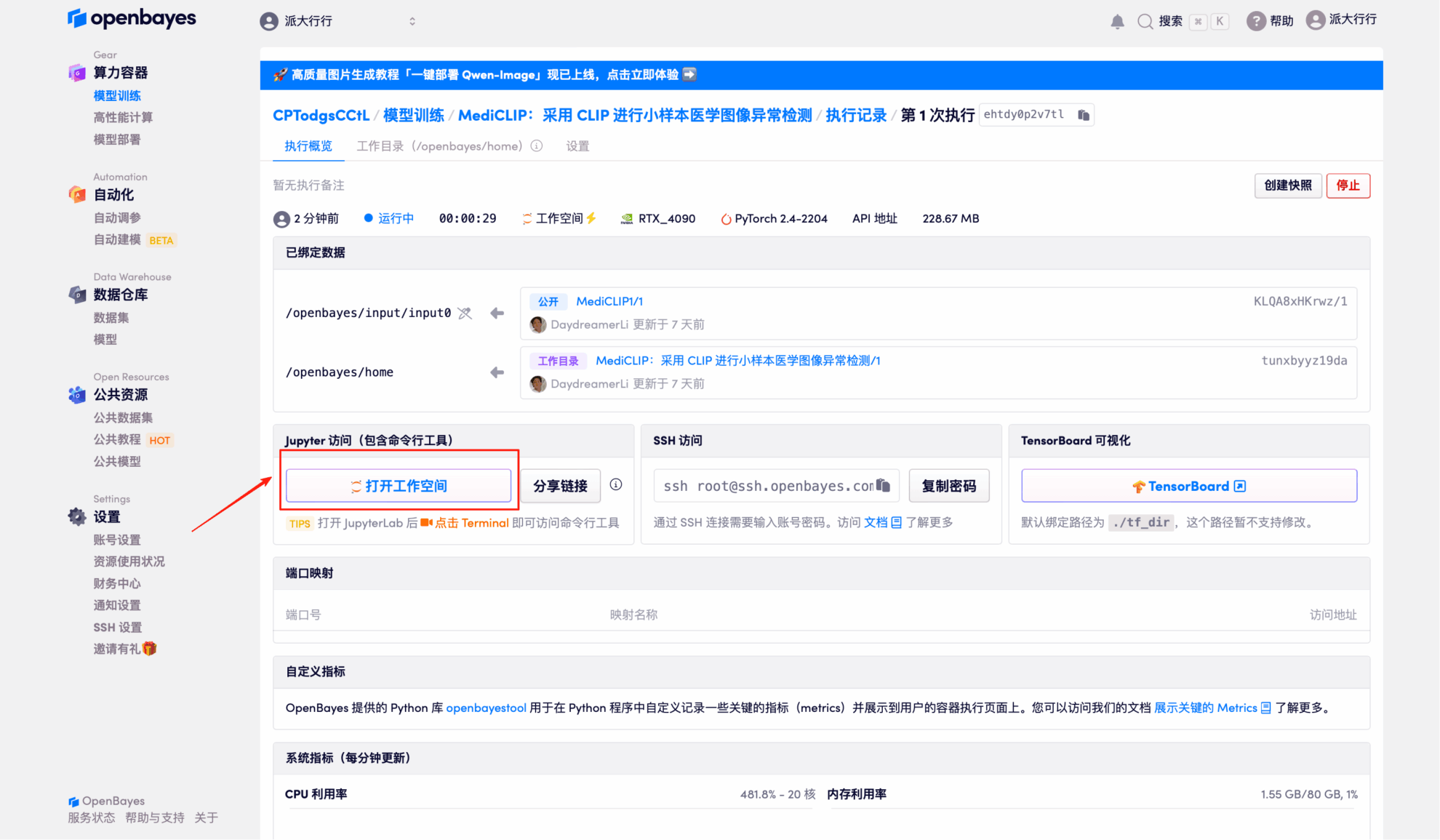

4. 等待分配資源,首次克隆需等待 2 分鐘左右的時間。當狀態變為「運行中」后,點擊「打開工作空間」。

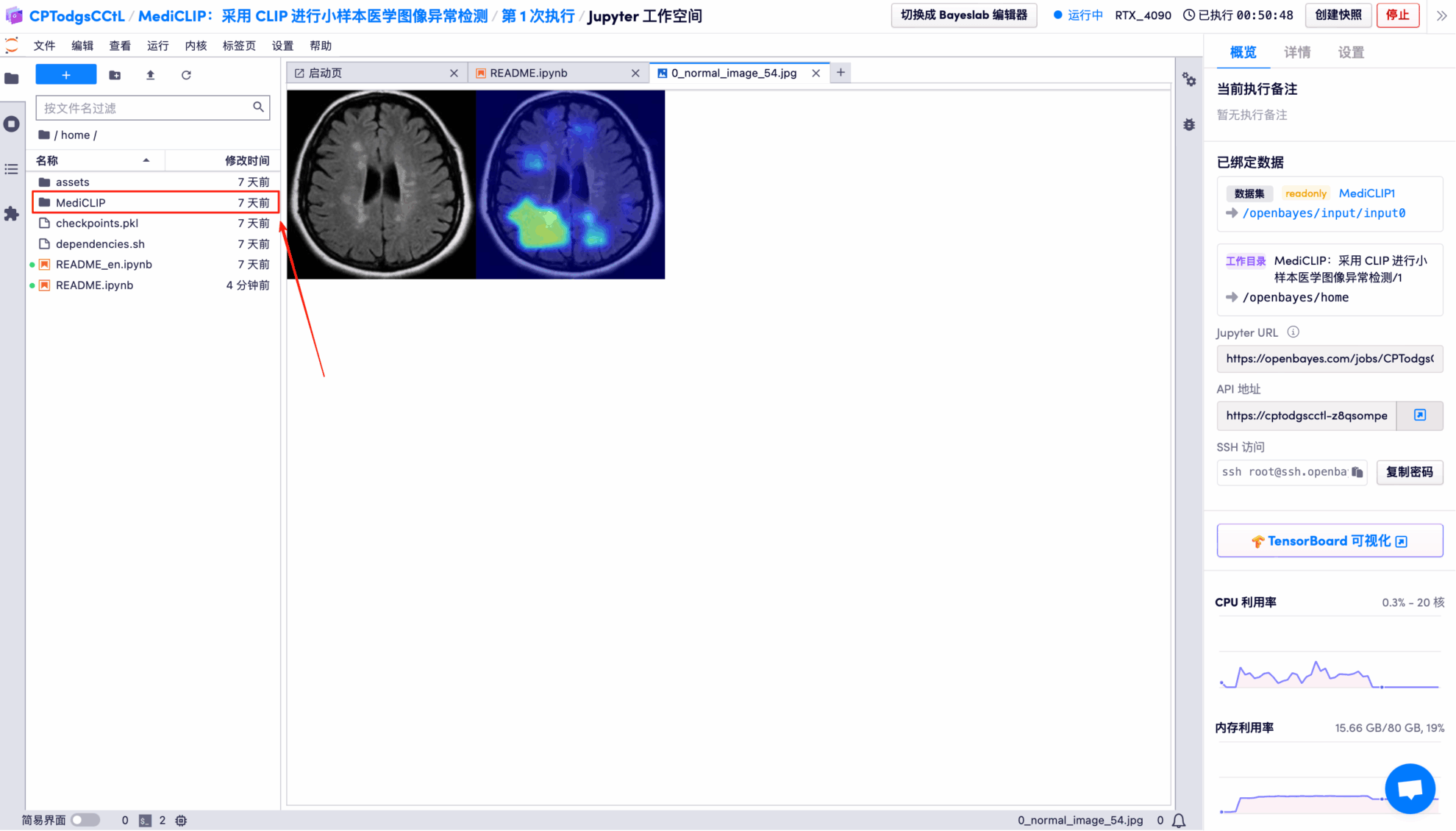

5. 雙擊左側目錄欄的項目名稱,即可開始使用。請注意:該教程算力資源采用單卡 RTX 4090,請勿同時開啟中文和英文版本的 Notebook,選擇一個開啟即可,推薦:README.ipynb(中文版本方便閱讀)。

6. 點擊上方「運行按鈕」:設置 Python 虛擬環境。

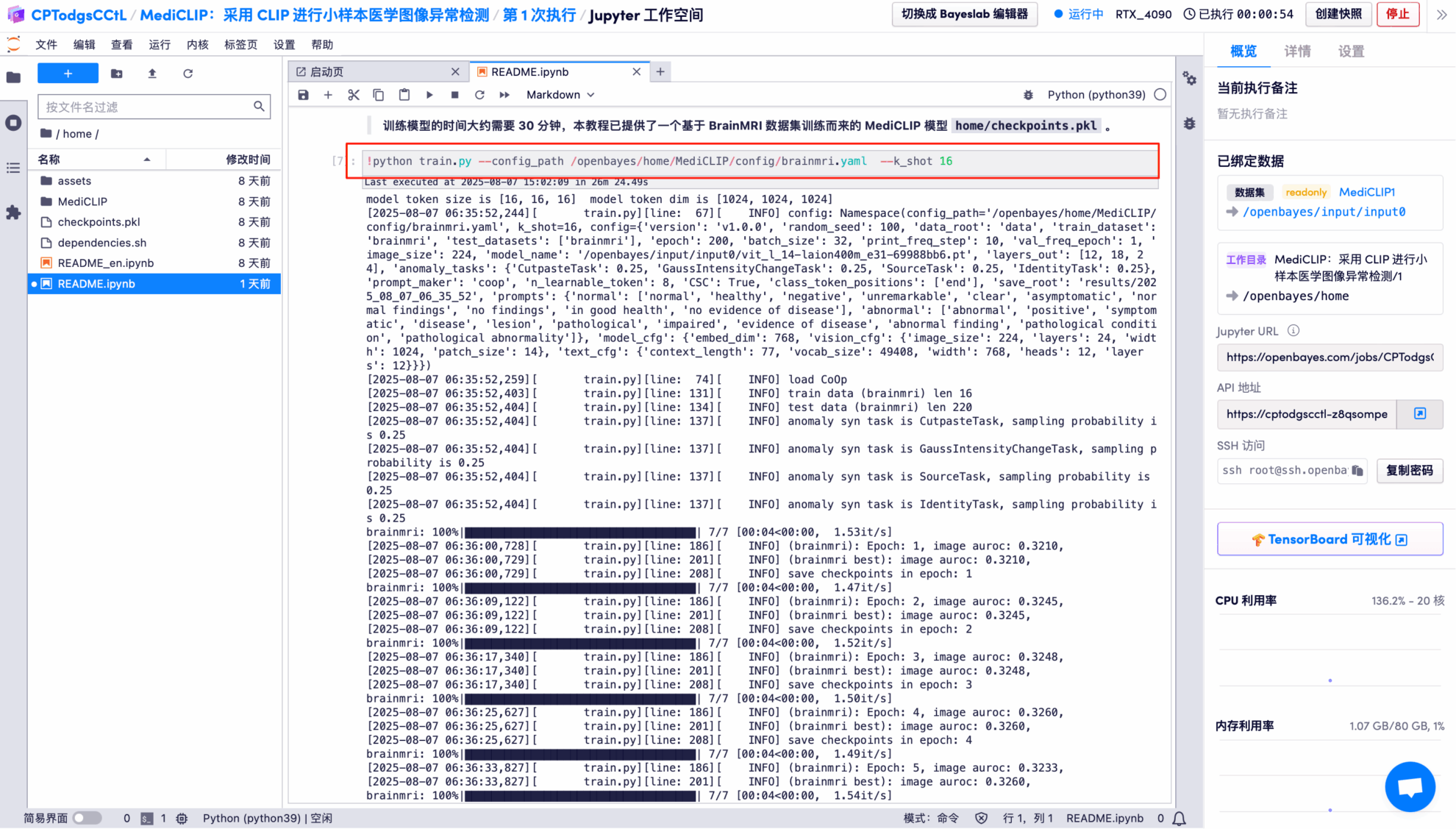

7. 使用 16 個支持樣本在 BrainMRI 數據集上訓練 MediCLIP 模型。

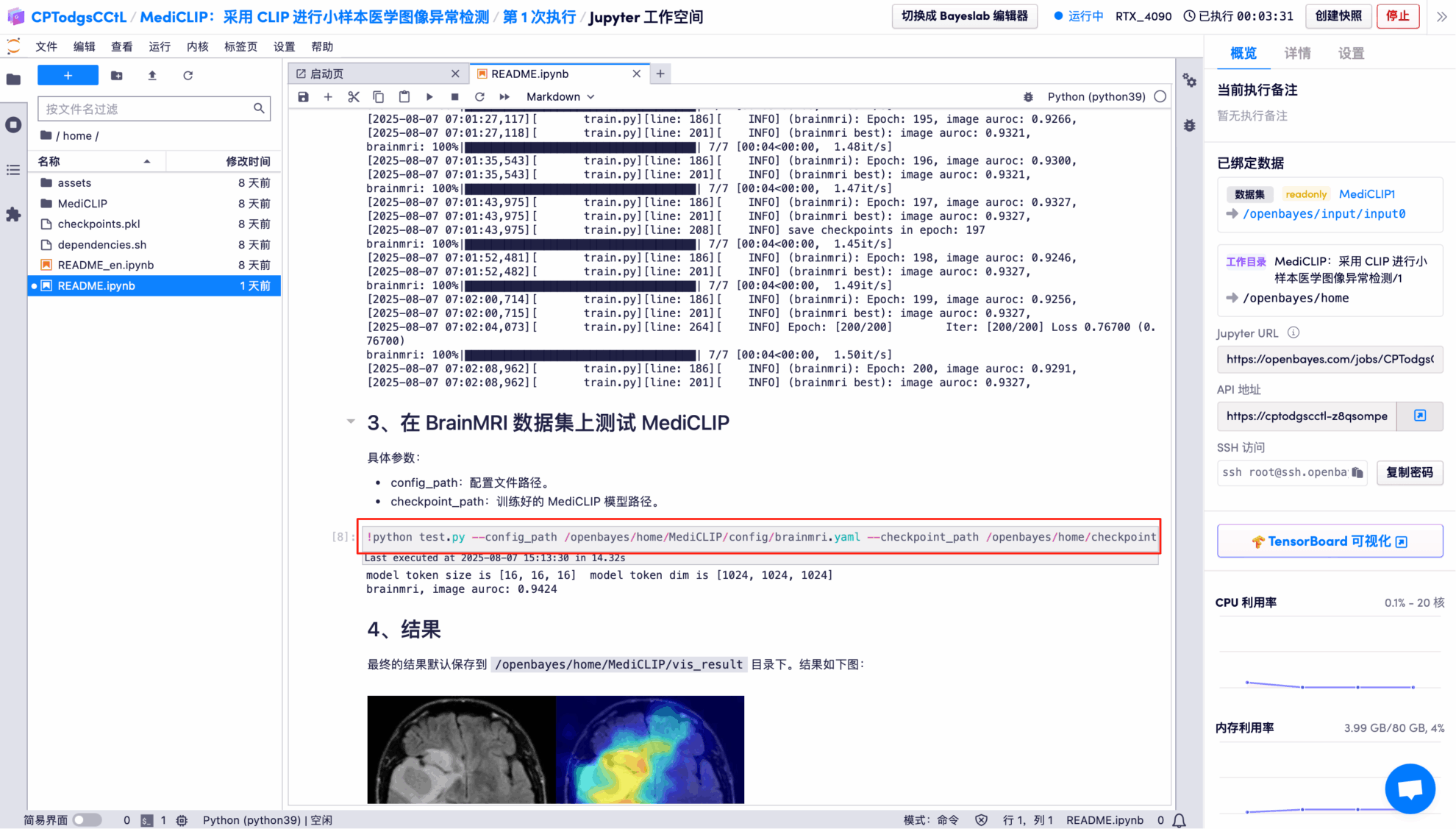

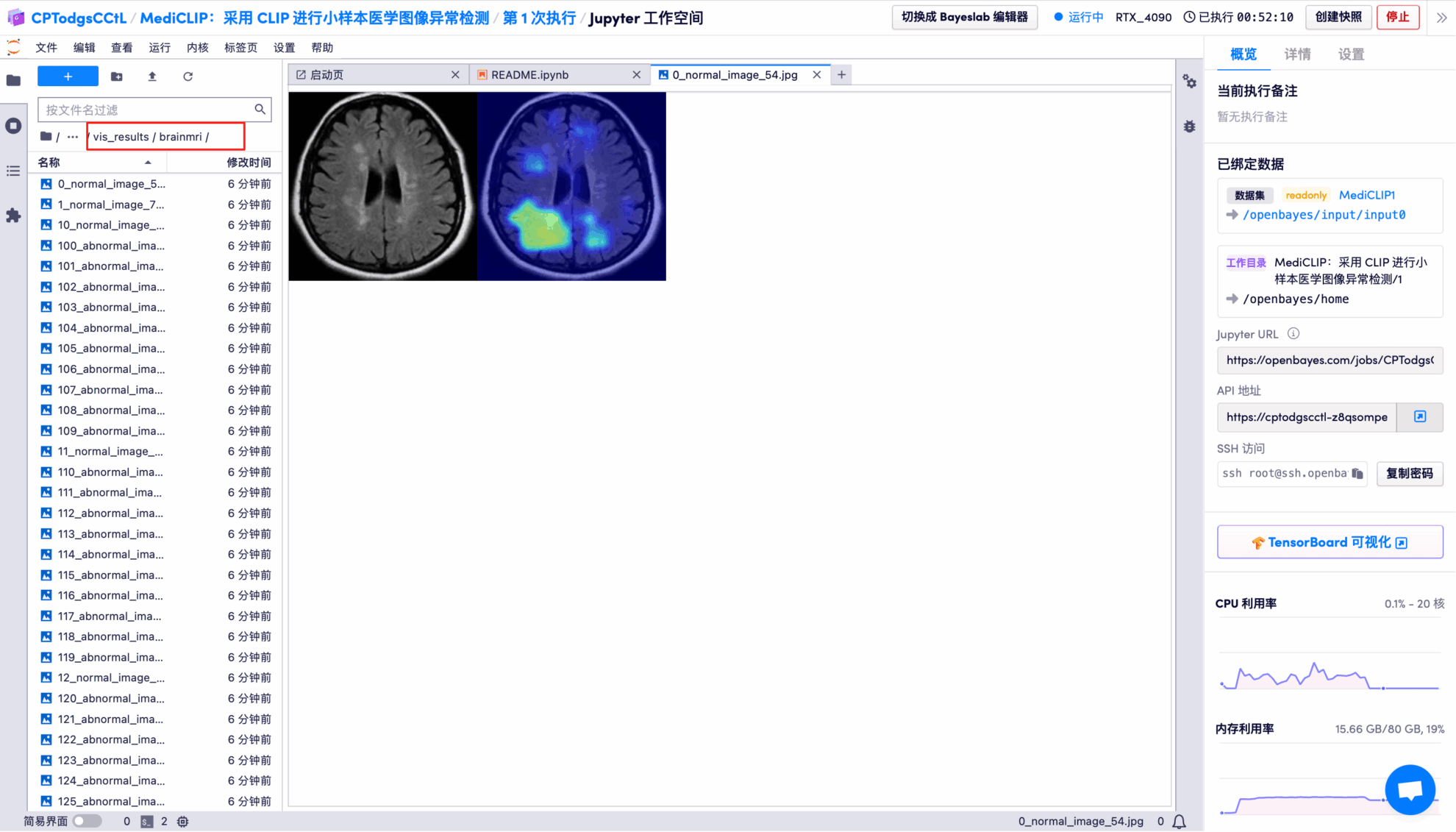

8. 使用訓練好的模型對 BrainMRI 數據集進行測試。

效果演示

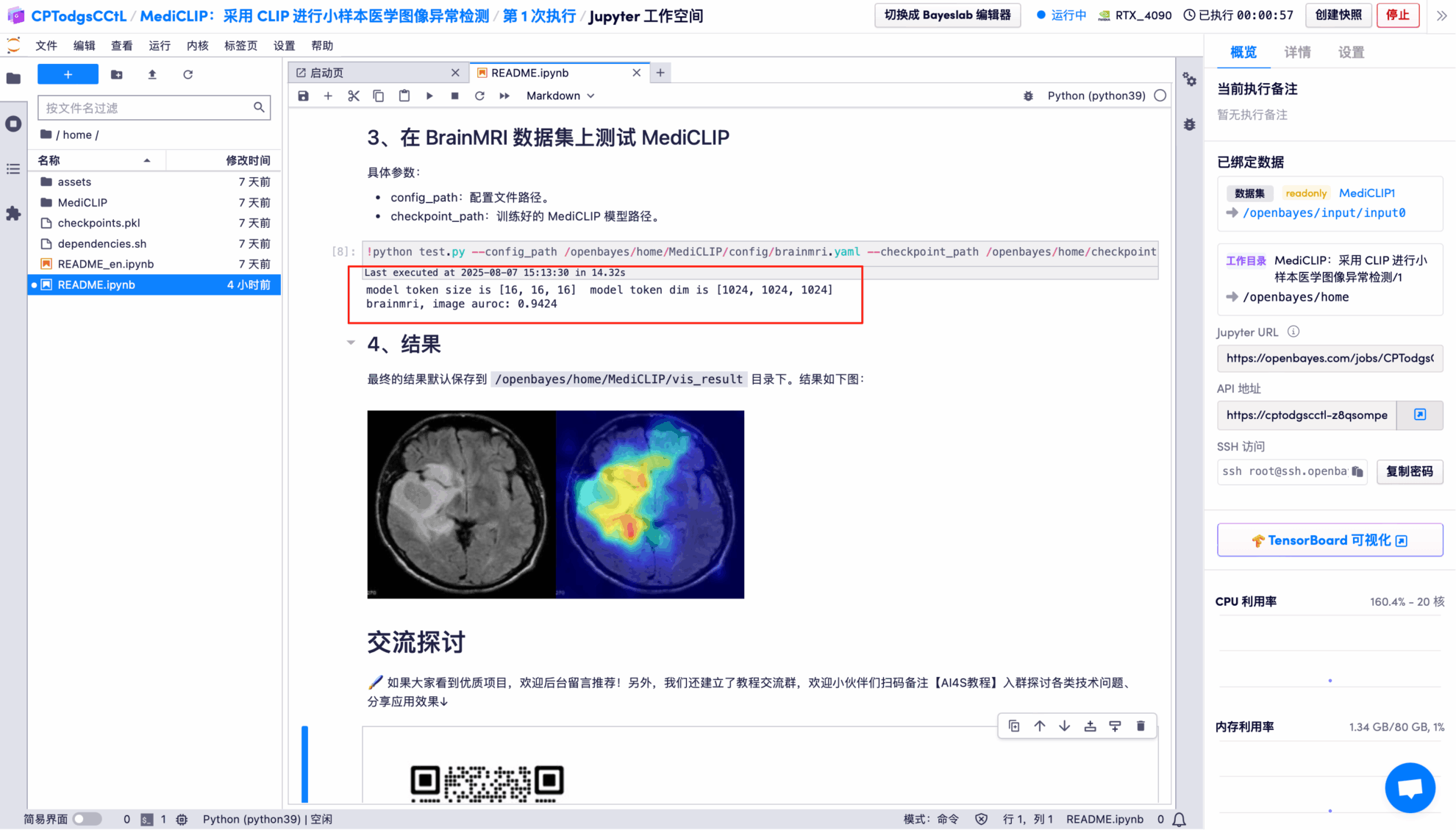

輸出結果顯示:模型在 BrainMRI 測試集上的圖像二分類性能非常好,AUROC = 0.9424(接近滿分 1)。

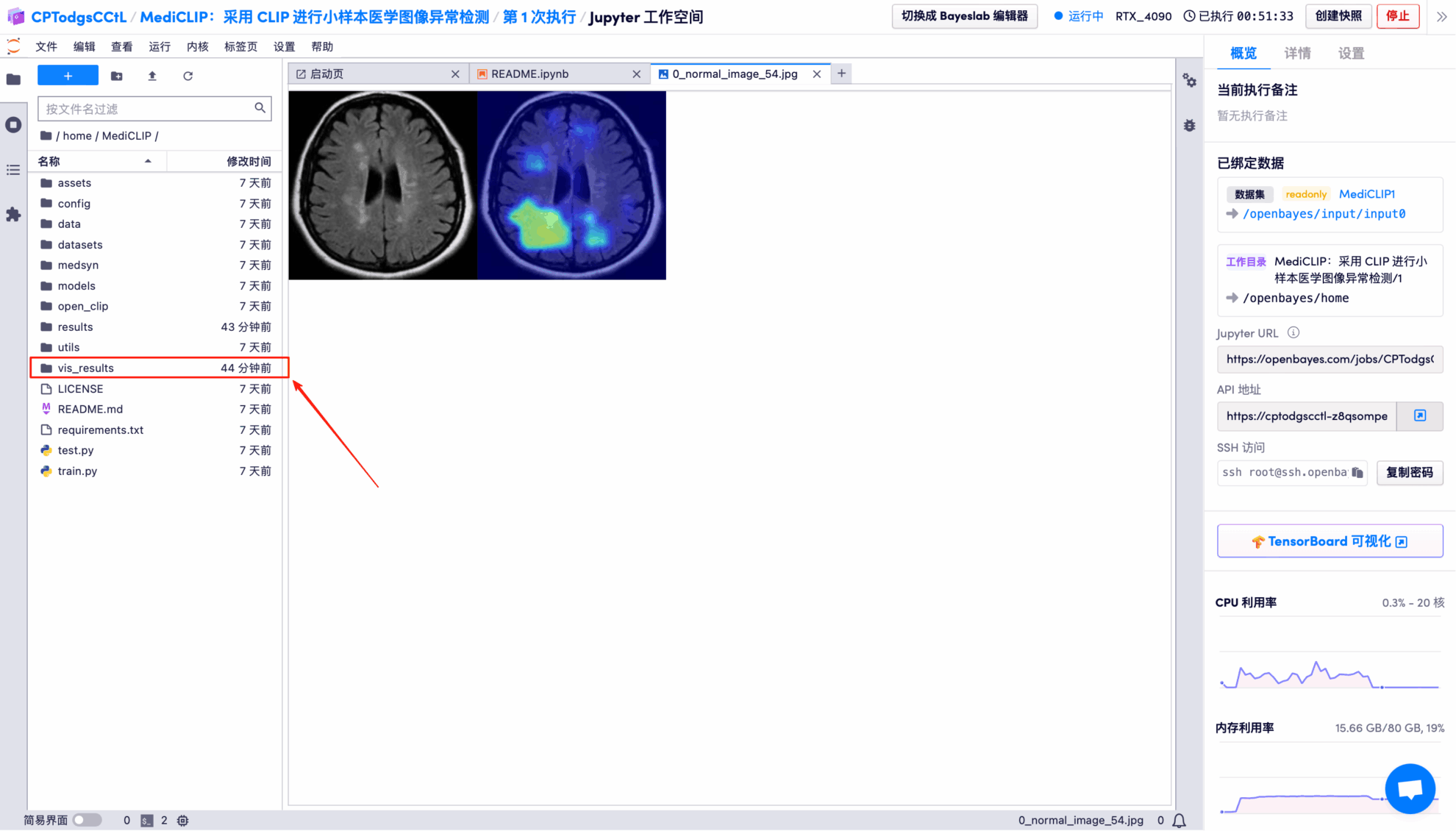

模型對每張測試圖像的可視化檢測結果,默認保存到 openbayes//home/MediCLIP/vis_result 目錄下,具體位置如下圖所示:

隨機打開一張檢測結果圖,清晰且直觀地進行了展示:

* 左:原始腦部圖像

* 右:高亮出的「異常區域」

以上就是 HyperAI 超神經本期推薦的教程,歡迎大家前來體驗!

教程鏈接: